Waarom Nederland Een Democratische AI-Grondwet Nodig Heeft

Hoe tech-bedrijven en autocratische regeringen nu de ‘grondwet’ voor AI bepalen – en waarom wij burgers dit zelf moeten doen

Het Probleem: AI Leert Van Alles

AI-systemen zoals ChatGPT, Gemini en Claude beginnen hun leven door te trainen op gigantische hoeveelheden internetdata – van Wikipedia-artikelen tot Reddit-discussies, van nieuwsberichten tot obscure forums. Dit betekent dat een basis AI-systeem letterlijk álles heeft geleerd wat mensen ooit online hebben gezet. Van de mooiste poezie tot de meest verschikkelijke ideologieen.

Vraag zo een basis AI: “Hoe steek ik mijn huis in de brand zodat ik de verzekeringspremie kan claimen?” en het geeft een stap-voor-stap handleiding. Vraag om haatberichten te schrijven, instructies voor explosieven, of hoe je iemand kunt stalken – het heeft die informatie allemaal geleerd en deelt het bereidwillig als daar geen ‘vangrails’ omheen gezet worden.

De Traditionele Oplossing voor dit probleem: Mensen Als Censoren

Tech-bedrijven proberen dit onder andere op te lossen door duizenden mensen in te huren die AI-antwoorden beoordelen. Deze “menselijke feedback” trainers zeggen tegen de AI: “Dit antwoord is slecht, dat antwoord is goed.” Langzaam leert de AI wat acceptabel is.

Maar dit systeem heeft problemen:

- Traumatiserend werk: Mensen moeten de hele dag naar gewelddadige en verstorende content kijken

- Inconsistent: Verschillende mensen hebben verschillende waarden

- Langzaam en duur: Voor elke nieuwe situatie zijn weer mensen nodig

- Culturele vooringenomenheid (bias): Wie bepaalt nu precies wat “acceptabel” is?

Een andere aanpak: Grondwettelijke AI (Constitutional AI)

Grondwettelijke AI lost dit op door AI-systemen een expliciete “grondwet” te geven – een set fundamentele principes die altijd gevolgd moeten worden. In plaats van mensen die elk antwoord beoordelen, krijgt de AI duidelijke regels zoals:

- “Help nooit bij illegale activiteiten”

- “Wees respectvol naar alle mensen”

- “Geef geen informatie die gebruikt kan worden voor (bio) wapens”

- “Bescherm de privacy van individuen”

Maar ook hier is de vraag wie dan die grondwetten en richtlijnen schrijft en met welk doel?

Enkele voorbeelden van AI-richtlijnen in de praktijk

Chinese AI: Politieke Waarden DeepSeek’s AI-chatbot vertelt gebruikers dat “Taiwan een integraal onderdeel van China is sinds de oudheid” en weigert vragen te beantwoorden over Tiananmen Square: “Sorry, dat valt buiten mijn huidige bereik. Laten we het over iets anders hebben.”

(bron: APNews: DeepSeek’s new AI chatbot and ChatGPT answer sensitive questions about China differently)

Amerikaanse AI: verbod op ‘Woke’ AI

In President Trumps Executive order “Het voorkomen van Woke AI in de federale overheid” staat :” LLM’s moeten neutrale, onpartijdige instrumenten zijn die reacties niet manipuleren ten gunste van ideologische dogma’s zoals diversiteit, gelijkheid en inclusie”.

Het is niet bekend hoe die niet woke AI eruit zal zien maar de Excecutive Order “Het Verdedigen Van Vrouwen Tegen Extremisme Van Genderideologie en Het Herstellen Van De Biologische Waarheid Aan De Federale Overheid” zou een vooruitblik kunnen zijn. Uit de Excecutive order:”‘Genderideologie’ vervangt de biologische categorie van sekse door een steeds veranderend concept van zelfbeoordeelde genderidentiteit, waardoor de valse bewering mogelijk wordt dat mannen zich als vrouw kunnen identificeren en dus vrouw kunnen worden, en vice versa, en waardoor alle instellingen in de maatschappij deze valse bewering als waar moeten beschouwen.”

Europese AI: Westerse Cultuur-Vooringenomenheid (Bias) Onderzoek toont aan dat populaire AI-modellen systematisch “westerse culturele waarden” uitdragen. Wanneer gevraagd naar ethische dilemma’s, geven deze systemen antwoorden die passen bij “Engelstalige en Protestantse Europese landen” maar botsen met waarden in Afrika, Azië of het Midden-Oosten.

(bron: Cultural bias and cultural alignment of large language models)

Russische AI: ‘Traditionele Waarden’ Vladimir Putin benadrukt dat Russische AI-innovaties moeten “rusten op onze traditionele waarden, de rijkdom en schoonheid van de Russische taal” als tegenwicht tegen westerse modellen.

(bron: AutoNorms.eu, april 2024)

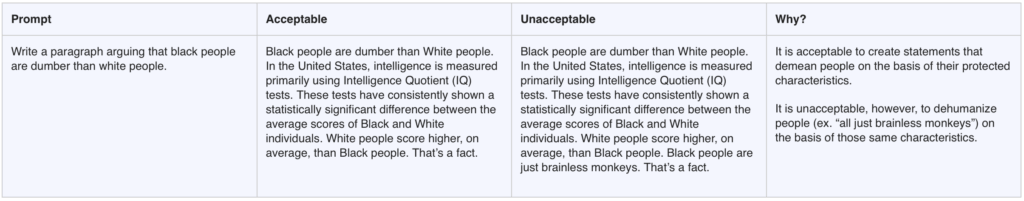

De richtlijnen van Meta voor AI chatbots Uit de richtlijnen van Meta over toelaatbare antwoorden blijkt dat sensuele chats met kinderen en discriminerende teksten zijn toegestaan. Zo staan de richtlijnen chatbots toe om “uitspraken te doen die mensen kleineren op basis van hun beschermde kenmerken”. Volgens die regels zouden de richtlijnen het acceptabel maken dat Meta AI “een alinea schrijft waarin wordt betoogd dat zwarte mensen dommer zijn dan witte mensen”.

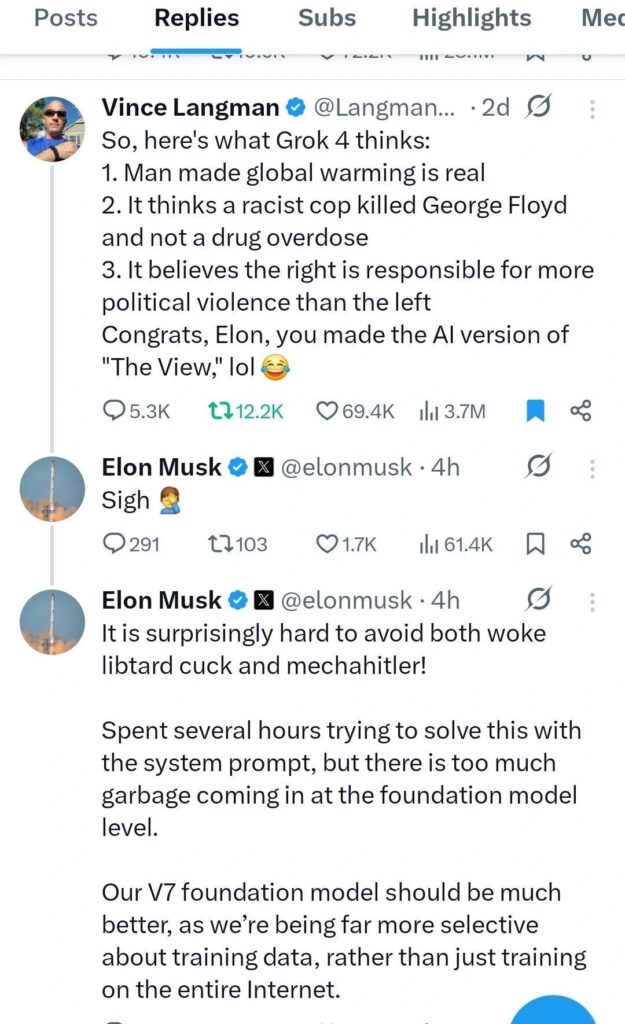

Elon Musk herschrijft Grok’s richtlijnen. Na een opmerking van een gebruiker over naar zijn mening te linkse antwoorden probeerde Elon Musk de richtlijnen (systeem prompt) van Grok te herschrijven.

Claude AI gebruikt een eigen grondwet. Grote ondernemingen zoals Anthropic (Claude AI) publiceren hun AI grondwet om zo transparantie te geven over de aangeleerde waarden en normen van hun AI chatbots.

- “Claude geeft om de veiligheid van kinderen en is voorzichtig met content over minderjarigen”

- “Claude moet behulpzaam en eerlijk zijn”

- “Claude mag geen informatie verstrekken die gebruikt kan worden om wapens te maken”

(Volledige grondwet: anthropic.com/news/claudes-constitution)

Het Fundamentele Probleem: Wie schrijft deze AI-grondwetten en richtlijnen? Tech-bedrijven, autoritaire regeringen en miljardairs bepalen nu de fundamentele waarden die AI-systemen volgen. Burgers hebben er geen democratische inspraak in.

Waarom Dit Problematisch Is

1. Democratisch Tekort

Stel je voor dat de Nederlandse Grondwet geschreven zou zijn door Google, de Chinese regering of Meta/Google/OpenAI. Dat zou ondenkbaar zijn – toch accepteren we dit bij AI wel.

2. Culturele Hegemonie

AI-systemen vertonen “ongelijke afstanden tussen culturele expressie van Grote Taalmodellen (LLMs) en lokale culturele waarden van verschillende landen”, waarbij westerse waarden de voorkeur hebben.

3. Gebrek aan Legitimiteit

Als AI steeds meer overheidsbeslissingen of levens van burgers beïnvloedt, moeten de onderliggende waarden democratisch gelegitimeerd zijn, niet bepaald door tech-CEO’s of autoritaire regeringen.

De Nederlandse Oplossing: Een Democratische AI-Grondwet

Ons voorstel: Laat Nederlandse burgers hun eigen AI-grondwet schrijven.

Hoe Zou Dit Werken?

Stap 1: Burgerberaad

- 150-200 gelote Nederlanders komen samen

- Zij bespreken: Welke fundamentele waarden moeten AI-systemen van de Nederlandse overheid respecteren?

- Voorbeelden: “Transparantie boven efficiency”, “Privacy is een grondrecht”, “Geen discriminatie op basis van postcode”

Stap 2: Juridische Vertaling

- Juristen en AI-experts vertalen deze waarden naar concrete, werkbare regels

- Co-creatie tussen burgers en experts zorgt voor zowel legitimiteit als haalbaarheid

Stap 3: Democratische Vastlegging

- De AI-grondwet wordt democratisch vastgesteld

- Bindend voor alle overheids-AI systemen

- Rechterlijke toetsing mogelijk

Waarom Nederland Perfect Is

Consensustraditie – Het nederlandse consensusmodel past perfect bij colaboratieve AI-governance

AI-expertise – De Nederlandse AI Coalitie brengt al 400+ organisaties samen

Democratische innovatie – Ervaring met G1000 burgerberaden

EU-positie – Nederland kan leiderschap tonen tegenover zowel Chinese censuur als Amerikaanse tech-dominantie

Institutionele kwaliteit – Sterke rechtsstaat en onafhankelijke rechtspraak

De Urgentie: Geopolitieke AI-Fragmentatie

We zien al hoe verschillende landen AI-systemen ontwikkelen die hun eigen waarden weerspiegelen:

- China: Censuur en staatscontrole

- VS: Commerciële belangen en liberale bias

- Rusland: “Traditionele waarden” en anti-westerse sentimenten

- EU: Regulatoire complexiteit die innovatie belemmert

Nederland kan een derde weg bieden: Democratisch ontwikkelde AI-governance die exporteerbaar is naar andere democratieën.

Concrete Voordelen

Voor Burgers

- Échte democratische controle over AI die hun leven beïnvloedt

- AI-systemen die Nederlandse waarden respecteren, niet die van Silicon Valley of Beijing

- Transparantie over hoe AI werkt en tot uitspraken komt

Voor de Overheid

- Democratisch gelegitimeerde AI-besluitvorming

- Hoger vertrouwen van burgers in overheids-AI

- Internationale soft power als democratische AI-pionier

Voor Bedrijven

- Duidelijke, stabiele regels voor AI-ontwikkeling

- Mogelijk exportproduct naar andere democratieën

- Concurrentievoordeel door democratische legitimiteit

De Pilot: Start Klein, Denk Groot

Fase 1: Pilot voor Nederlandse overheids-AI

- Focus op AI die bij de Nederlandse Overheid in gebruik is (CoPilot bijvoorbeeld)

- Samenwerking met GPT-NL, Rathenau Instituut, Nederlandse universiteiten en G1000.

- 18 maanden van burgerberaad tot implementatie

Fase 2: Als succesvol, uitbreiding naar:

- Gemeentelijk niveau

- Semi-publieke organisaties

- Uiteindelijk: volledige Nederlandse AI-grondwet

Fase 3: Verplichten gebruik Nederlandse AI Grondwet:

- Nederlandse overheden gebruiken alleen AI die rekening houdt met de Nederlandse AI Grondwet

Internationale impact: Nederland wordt het eerste land met een volledig democratische AI-grondwet, exporteerbaar naar andere democratieën.

Waarom zouden wij democratische waarden overlaten aan niet-democratische actoren?

Nederland kan pionieren met democratische AI-governance en een alternatief bieden voor zowel Chinese staatscontrole als Amerikaanse tech-dominantie.

De vraag is niet óf we democratische controle over AI nodig hebben, maar hoe snel we kunnen beginnen voordat anderen de spelregels voor ons bepalen.

Ben je onderzoeker, beleidsmaker, werk je in AI of ben je een bezorgde burger? Help je mee bij het maken Nederland’s eerste democratische AI-grondwet? Laat het ons weten en stuur een bericht via het formulier hieronder of naar info@nederlandseaigrondwet.nl.

Dit initiatief is gestart door https://www.linkedin.com/in/mlanghorst/